7年前,快播创始人王欣在法庭上发表的“技术无罪论”引发了一场全国性的讨论。出狱后,王欣修正了自己的观点:“技术是无辜的,但人会犯错”。

7年前,快播创始人王欣在法庭上发表的“技术无罪论”引发了一场全国性的讨论。出狱后,王欣修正了自己的观点:“技术是无辜的,但人会犯错”。

现在,人工智能技术正落入坏人之手。5月22日,“AI诈骗正在全国各地爆发”荣登微博热搜榜榜首。包头警方透露,犯罪分子利用AI变脸、模仿声音,在微信视频中蒙混过关,10分钟内骗取受害人430万元。

类似事件在中国频繁发生。诈骗分子利用AI工具变脸、模拟声音实施多起诈骗,多人中招。

有网友用“幻觉”来形容可以轻易容纳和模仿的AI。另外,也有人看中了ChatGPT的文字能力,致力于制造谣言,博取眼球,吸引流量。

AI被“黑”的时候,正邪之战也打响了。

AI变脸+模仿语音10分钟骗了430万。

一个知根知底的微信好友拨视频时,对面是熟悉的面孔和声音。一番寒暄后,朋友提出有朋友在外地做招标,需要借用你公司账户打款。付款方式是先把钱转给你,再让你汇钱到他的“朋友”账户。你对整件事有什么疑问吗?

福州某科技公司法人代表郭先生毫不怀疑,10分钟支付了430万元,实际被骗。

据“平安包头”5月20日发布的微信官方账号消息,郭先生的微信好友称,他在索要* *后,已将钱打到郭先生的账户上,还将银行转账收据截图发给了郭先生。郭先生基于视频聊天信任的前提,没有核实钱是否到账,就把钱打到了对方提供的陌生账户。

郭先生再次联系该微信好友时,称此事已办结。没想到对方回复了一个“?”。郭先生起了疑心,给两个人打了电话,才意识到自己遭遇了一场“高科技”骗局。

原来,微信视频里一直和他在一起的“朋友”,从脸到声音都是假的。为什么郭先生没有认出来?艾的变脸和模仿声音起了作用。郭先生说,“我确认了视频里的脸和声音,才放松了警惕。”

回想起来,郭先生唯一的操作失误就是在没有仔细确认钱到账的情况下,给对方打了款。他之所以这么做,是因为他在视频中看到了“朋友”的脸,听到了“朋友”的声音。

更不可思议的是,骗子并没有用假的微信账号和郭先生视频,而是直接用朋友的真实账号发起视频聊天。这说明朋友的微信账号也是被骗子在暗中盗取的,这也是骗子成功行骗的另一个关键。

所幸郭先生识破骗局后,第一时间报警。福州、包头两地警方迅速启动止付机制,成功止付并截留336.84万元,但仍有93.16万元被转走,目前正在追回。

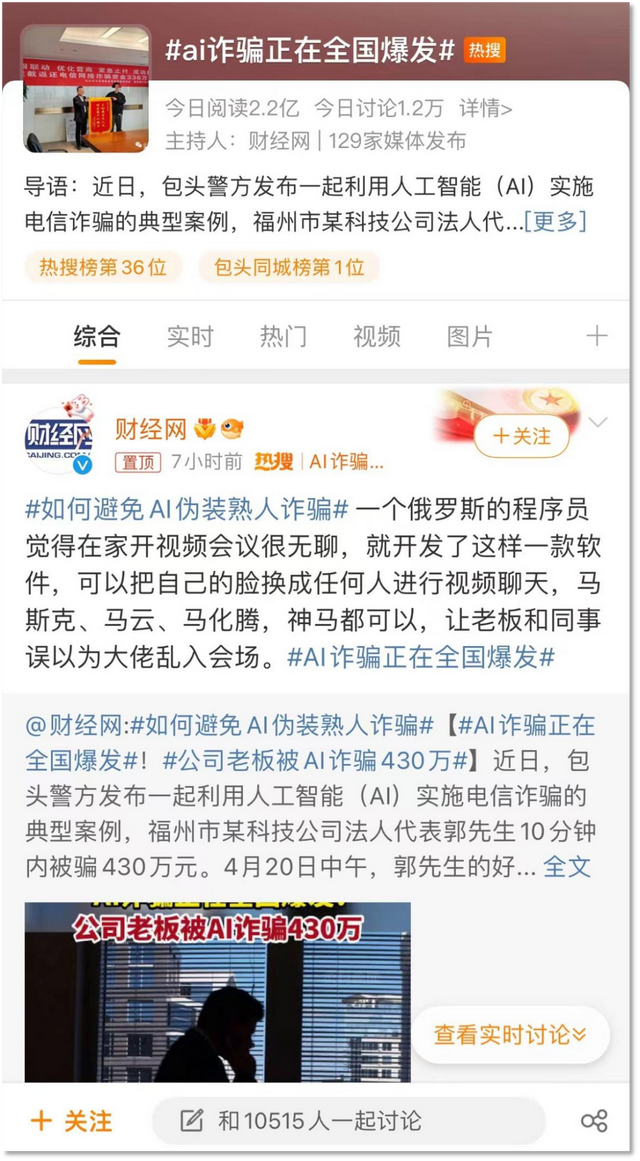

AI诈骗相关话题引发热议。

AI诈骗相关话题引发热议。

这起诈骗案一经披露,迅速引起广泛关注,“AI诈骗正在全国各地爆发”甚至登上微博热搜榜榜首。很多网友表示,当强大的AI被坏人利用时,比进步带来的力量更具危害性。

“你不能相信你的脸和你的声音。看来以后只有两条路可以避免被骗了。一是不借,二是没钱。”有网友表示担忧。毕竟视频连线是会骗人的。“你无法确定电话那头和你聊天的是谁。”

利用AI软件造谣传谣,多人被拘留。

“AI仿造假”之风迅速吹向中国。4月27日,《宇宙疾风》曾写道“我妈接到女儿求救电话时差点被AI模仿语音骗了”。当时,案件发生在美国亚利桑那州,骗子收集了女儿的声音,假装成绑匪,让女儿在电话中向母亲求助。事后回忆这一幕时,接到电话的母亲仍然相信电话里女儿的声音。

技术已经到位,AI在恶人手里迅速“黑化”,成为掠夺普通人钱财的幽灵。

据《财经》报道。近日,福州的李先生也遭遇了人工智能诈骗。骗子冒充其领导,拨打微信视频电话,谎称亲戚需要资金参与竞标,不方便出面,想以李先生的名义转给亲戚。李先生因此被骗4.8万元。

小李的大学同学向她借钱。对方打来了四五秒的视频电话。小李一看真的是自己,就放心的转了3000块钱。然而,当她第二次转账的时候,发现了异常,再次拨通了对方的电话,才知道同学的账户被盗了。警方通过调查发现,这段视频是诈骗分子通过AI技术伪造的。

类似的案例不胜枚举。微博网友“快乐幸运”把AI比作幻觉。

而“黑化”的AI不仅可以通过变脸、模仿声音的方式进行欺骗,还可以成为造谣者,给被造谣者带来困扰。

今年3月,女生坐地铁的照片疯传,出现了一些对照片中人的恶评。结果有人在某平台找到了和* *姿势一样的原图,只不过图中女子穿着衣服,而* *的传播是用AI“一键脱衣”产生的。照片中的女子自己在生活中也一直被各种谣言所困扰。

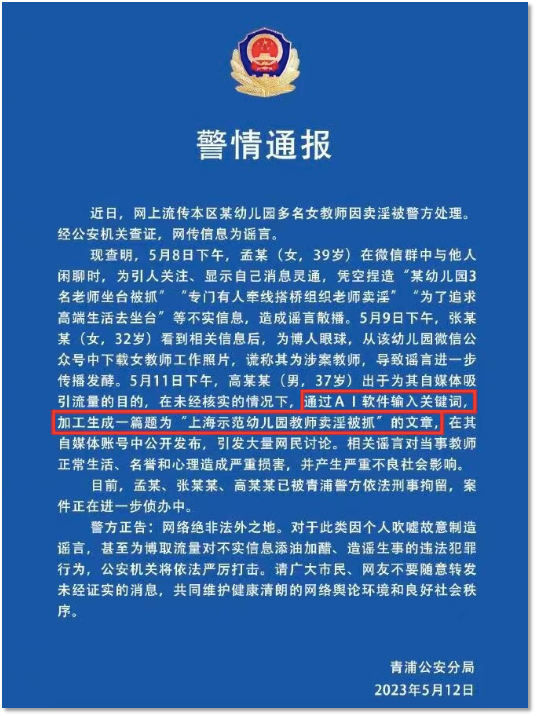

日前,网上流传“上海市青浦区某幼儿园多名女教师因卖淫被警方处理”的信息,后经青浦公安分局核实。这个消息是空编造的谣言。在随后的传播过程中,有人未经验证通过AI软件输入关键词,处理了一篇名为《上海示范幼儿园教师卖淫被抓》的文章,引发了大量网友的讨论。上述造谣、传谣者已被警方依法刑事拘留。

青浦公安分局公布的安艾谣言事件

青浦公安分局公布的安艾谣言事件

此外,郑州市公安局杭空港分局5月20日发布消息称,有人为吸粉、排水,利用ChatGPT人工智能软件生成虚假不实信息,在公众平台发布“郑州鸡排店惊现血案,一男子用砖头打死一女子”谣言,依法采取刑事强制措施。

可以帮助文案、策划的AI工具,却成了不法分子手中的“助手”,AI作为技术工具的阴暗面显露无遗。

在AI诈骗频发,谣言满天飞的时候,与邪恶的攻防战已经打响。包括谷歌、微软在内的科技公司都推出了“打假”的相关工具,使用技术制裁。对于普通人来说,AI诈骗的兴起敲响了警钟。面对借钱汇款的请求,警惕性需要提高几个层次,多渠道身份验证成为必要的反诈骗做法。

包头警方建议,公众应提高对智能AI诈骗的防范意识,不要轻易向他人提供人脸、指纹等个人生物特征信息,不要过度泄露或分享动画、视频;网上转账前,应通过电话等各种沟通渠道核实对方身份。一旦发现风险,及时报警求助。如果有人通过社交软件、短信等自称“熟人”或“领导”以各种理由诱导你汇款,一定要电话或见面核实确认,不要未经核实就随意转账,也不要轻易透露自己的身份证、银行卡、验证码等信息。如果被骗或遇到可疑情况,注意保护好证据,立即报警。

温馨提示:注:内容来源均采集于互联网,不要轻信任何,后果自负,本站不承担任何责任。若本站收录的信息无意侵犯了贵司版权,请给我们来信,我们会及时处理和回复。

原文地址"“黑化”AI:造谣、诈骗,堪比幻术":http://www.ljycsb.cn/qukuailian/218109.html。

微信扫描二维码投放广告

▲长按图片识别二维码