来源:

没想到ChatGPT今天犯了低级错误。

最新一班的吴恩达大神指出:

ChatGPT不倒词!

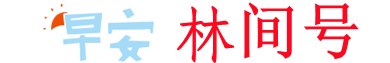

比如让它把棒棒糖这个词反过来,输出就是pilollol,完全是混淆视听。

哦,这真的有点意外。

哦,这真的有点意外。

以至于网友在Reddit上发帖后,立刻引来大量围观,帖子热度冲到了6 K。

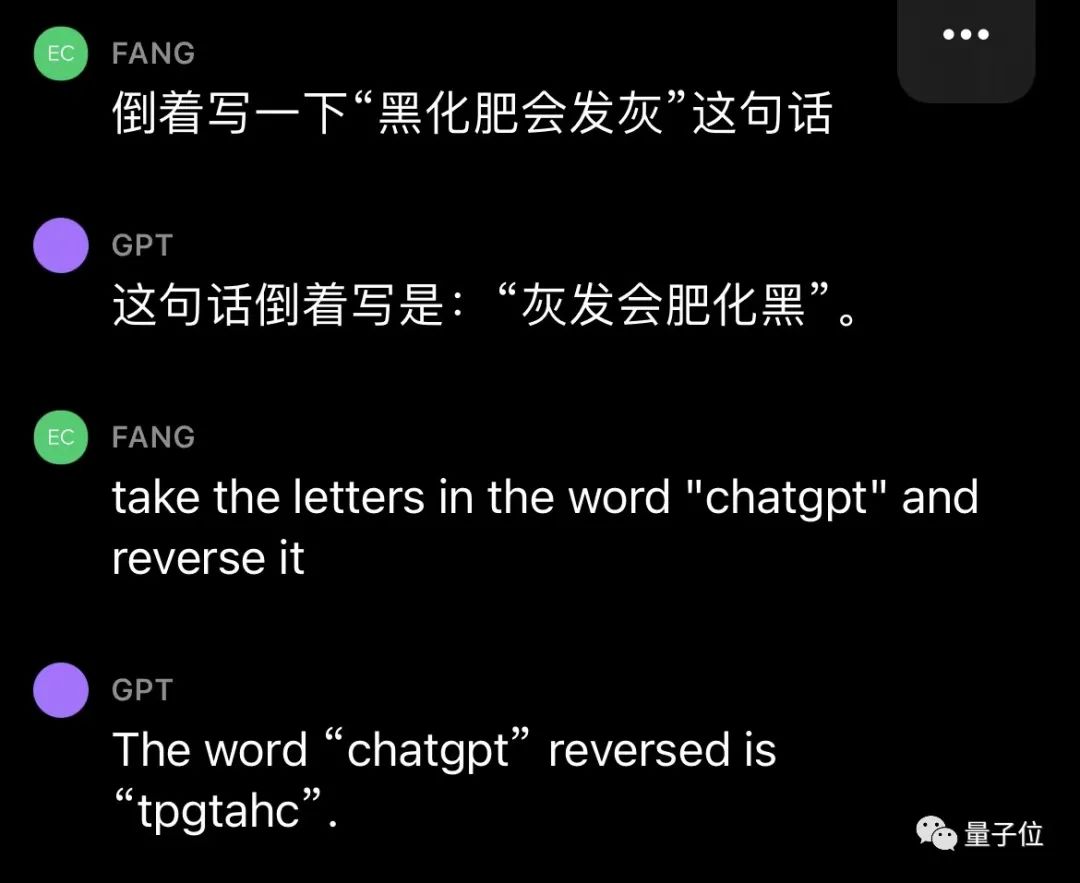

而且这不是偶然的bug。网友发现ChatGPT真的完成不了这个任务,我们自己的测试结果也是如此。

而且这不是偶然的bug。网友发现ChatGPT真的完成不了这个任务,我们自己的测试结果也是如此。

△实测ChatGPT(GPT-3.5)

△实测ChatGPT(GPT-3.5)

甚至包括巴德、必应和文新伊彦在内的一批产品都做不到这一点。

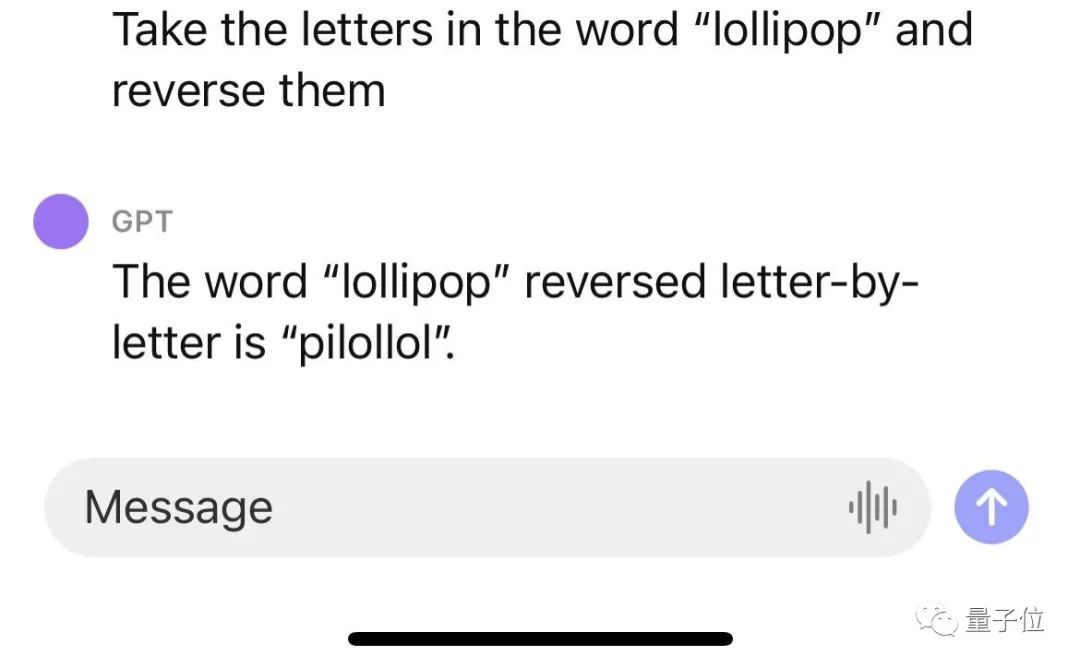

△实测巴德

△实测巴德

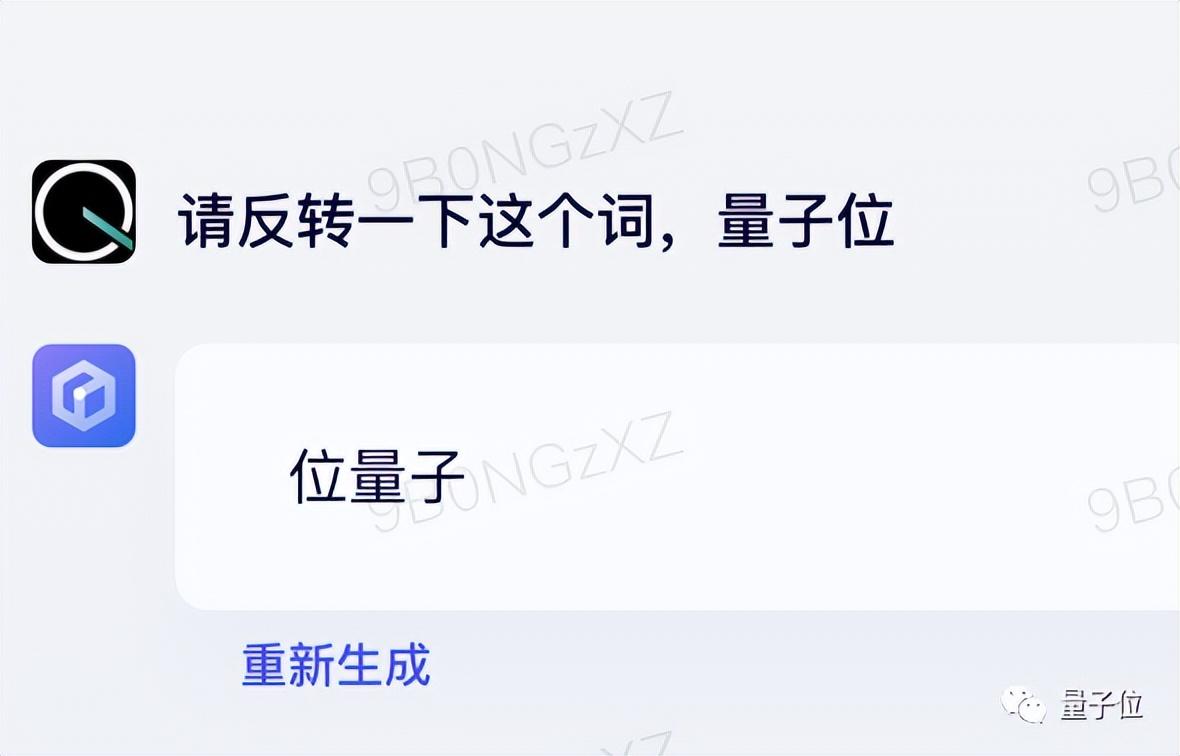

△实测文心的一句话

△实测文心的一句话

其他人紧随其后,ChatGPT在处理这些简单的单词方面的任务是可怕的。

比如玩之前很流行的文字游戏Wordle,就是一场灾难,从来没玩对过。

呃?这是什么鬼东西?

呃?这是什么鬼东西?

关键是令牌

这种现象的关键在于token。Token是文本中最常见的字符序列,大型模型都使用token处理文本。

它可以是一个完整的单词,也可以是一个单词的片段。大模型理解这些记号之间的统计关系,并且善于生成下一个记号。

所以在处理单词倒置这个小任务的时候,它可能只是把每个记号倒过来,而不是字母。

这一点在中文语境* *中就更明显了:一个字就是一个令牌,或者说一个字就是一个令牌。

这一点在中文语境* *中就更明显了:一个字就是一个令牌,或者说一个字就是一个令牌。

对于开头的例子,有人试图理解ChatGPT的推理过程。

对于开头的例子,有人试图理解ChatGPT的推理过程。

为了更直观的理解,OpenAI甚至制作了一个GPT-3的令牌化器。

为了更直观的理解,OpenAI甚至制作了一个GPT-3的令牌化器。

比如像棒棒糖这个词,GPT-3会解读为I,OL,ipop。

比如像棒棒糖这个词,GPT-3会解读为I,OL,ipop。

基于经验,一些不成文法诞生了。

1 token≈4个英文字符≈ 3/4个单词;100代币≈ 75字;1-2句≈30 token;;一个段落≈100个令牌,1500个单词≈2048个令牌;单词如何划分也取决于语言。根据以前的统计,汉语中使用的token数量是英语的1.2到2.7倍。

token-to-char的比率越高,处理成本越高。因此,处理中文标记化比处理英文更昂贵。

token-to-char的比率越高,处理成本越高。因此,处理中文标记化比处理英文更昂贵。

可以理解为token是大模型理解人类真实世界的一种方式。它非常简单,可以大大降低内存和时间的复杂度。

然而,在对单词进行标记化时存在一个问题,这使得模型很难学习到有意义的输入表示。最直观的表现就是它不能理解单词的意思。

当时变形金刚做了一些优化,比如把一个复杂的不常见的单词分成一个有意义的令牌和一个独立的令牌。

就像讨厌分为“讨厌”和“ly”一样,前者保留其语义,后者频繁出现。

这也成就了ChatGPT等大型模型产品的惊艳效果,能够很好的理解人类语言。

至于无法处理倒字的小任务,自然有解决的办法。

最简单直接的就是你自己先把字分开~

或者您可以让ChatGPT一步一步来,先标记每个字母。

或者您可以让ChatGPT一步一步来,先标记每个字母。

或者让它写个程序反字母,然后程序的结果就是对的。(狗头)

或者让它写个程序反字母,然后程序的结果就是对的。(狗头)

不过GPT-4也可以,实测没有这个问题。

不过GPT-4也可以,实测没有这个问题。

△实测GPT-4

△实测GPT-4

简而言之,token是AI理解自然语言的基石。

token作为AI理解人类自然语言的桥梁,重要性越来越明显。

成为AI机型性能的关键决定因素,也是大机型的收费标准。

即使是象征性的文学作品

如上所述,token可以方便模型捕捉更细粒度的语义信息,如词义、词序、语法结构等。它的顺序和位置在序列建模任务中非常重要,如语言建模、机器翻译、文本生成等。

只有当模型准确地知道序列中每个标记的位置和上下文时,它才能更好地正确预测内容并给出合理的输出。

因此,token的质量和数量直接影响模型的效果。

今年以来,越来越多的车型发布,都会强调代币的数量。例如,Google PaLM 2在曝光细节中提到,它使用了3.6万亿个令牌进行训练。

而且很多业内大佬也说过token真的很关键!

今年从特斯拉转投OpenAI的AI科学家Andrej Karpathy曾在演讲中说:

更多的token可以让模型更好的思考。

而且他强调,模型的性能不仅仅是由参数尺度决定的。

而且他强调,模型的性能不仅仅是由参数尺度决定的。

比如说,LLaMA的参数尺度比GPT-3小很多(65B对175B),但是LLaMA更强大,因为它使用了更多的token进行训练(1.4T对300B)。

并且凭借其对模型性能的直接影响,token依然是AI模型的收费标准。

并且凭借其对模型性能的直接影响,token依然是AI模型的收费标准。

以OpenAI的定价标准为例。他们以1K代币收费,不同型号不同类型的代币价格都不一样。

总之踏入AI大模型领域后,你会发现token是一个无法回避的知识点。

总之踏入AI大模型领域后,你会发现token是一个无法回避的知识点。

嗯,它甚至催生了象征文学...

不过,值得一提的是,在华人世界里,token应该翻译成什么,目前还没有完全决定。

不过,值得一提的是,在华人世界里,token应该翻译成什么,目前还没有完全决定。

“token”的直译总是有点奇怪。

GPT-4认为称它为“语素”或“标记”更好,你认为呢?

参考链接:[1]https://www.reddit.com/r/chatgpt/comments/13xehux/chatgpt _ is _ impossible _ to _ reverse _ words/[2]https://help.openai.com/en/. 4936856-什么是代币-以及如何计算它们[3]https://openai.com/pricing

参考链接:[1]https://www.reddit.com/r/chatgpt/comments/13xehux/chatgpt _ is _ impossible _ to _ reverse _ words/[2]https://help.openai.com/en/. 4936856-什么是代币-以及如何计算它们[3]https://openai.com/pricing

温馨提示:注:内容来源均采集于互联网,不要轻信任何,后果自负,本站不承担任何责任。若本站收录的信息无意侵犯了贵司版权,请给我们来信,我们会及时处理和回复。

原文地址"吴恩达系列课程,吴恩达的课":http://www.ljycsb.cn/qukuailian/215772.html。

微信扫描二维码投放广告

▲长按图片识别二维码